こちらを読むと

- 多クラスロジスティック回帰について、モデル出力を確率で表す方法が分かります

確率の表し方

前回までの記事で、多クラスロジスティック回帰のモデル出力がの式で表せることを説明しました。

$$

{\bf y} = f(W{\bf x} + {\bf b})

$$

ここでは、入力データがそれぞれのクラスに分類される確率を出してみましょう。

入力\({\bf x}\)に対して、分類されるいずれかのクラス値をとる確率変数を\(C\)とします。2値ロジスティック回帰のときは、\(C=0\)または\(C=1\)で表しました。

多クラスでは、\(C=k (k=1, 2, \dots, K)\)となります。

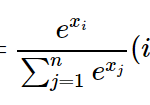

ある1つのニューロンの出力y_kを考えると、これは\({\bf x}\)がクラス\(k\)に分類される確率になります。

$$

\begin{eqnarray}

p(C=k|x) = y_k &=& f({\bf w}_k^T{\bf x} + b_k)\\

&=& \frac {exp({\bf w}_k^T{\bf x} + b_k)}{\sum_{j=1}^N exp({\bf w}_j^T {\bf x} + b_j)}

\end{eqnarray}

$$

まとめ

- 多クラスロジスティック回帰について、モデル出力を確率で表す方法が分かりました

モデル出力を確率で表すことができたので、2値ロジスティック回帰と同様に交差エントロピー誤差関数が使えそうですね。次回はその求め方について書きます。

多クラスロジスティック回帰は式変形が複雑なので、ステップ・バイ・ステップで着実に進めていこうと思います。

Reference

詳解ディープラーニング

https://book.mynavi.jp/manatee/books/detail/id=72424null